最近注意到在一些caffe模型中,偏置项的学习率通常设置为普通层的两倍。具体原因可以参考(https://datascience.stackexchange.com/questions/23549/why-is-the-learning-rate-for-the-bias-usually-twice-as-large-as-the-the-lr-for-t),貌似没有文章提到这个。

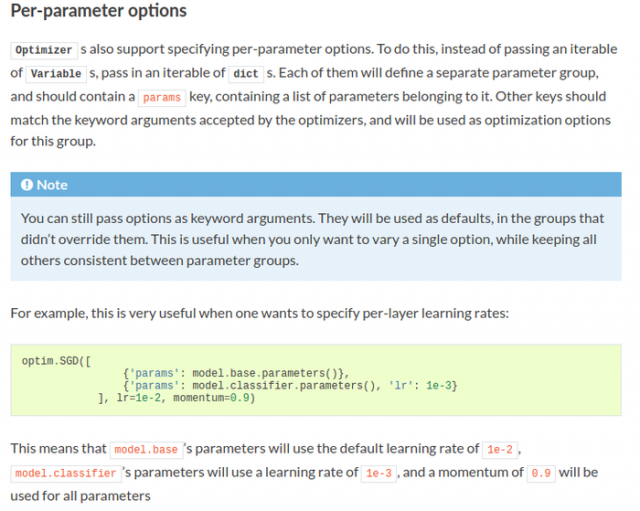

Pytorch中也提供了对不同层设置不同学习率以及衰减因子的方法。

主要方法是传递一个dict给optimizer,而不是list。

下面以restnet18进行说明:

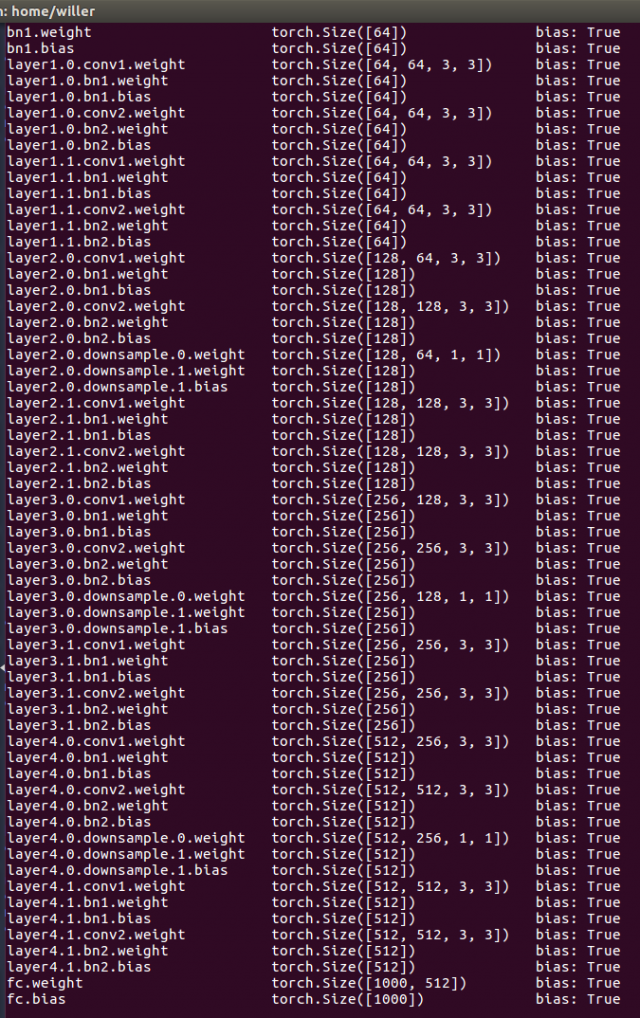

首先加载resnet18 模型,并打印其参数设置:

import torch, torchvision

model = torchvision.models.resnet18()

paras = dict(model.named_parameters())

for k, v in paras.items():

print(k.ljust(30), str(v.shape).ljust(30), 'bias:', v.requires_grad)

输出为:

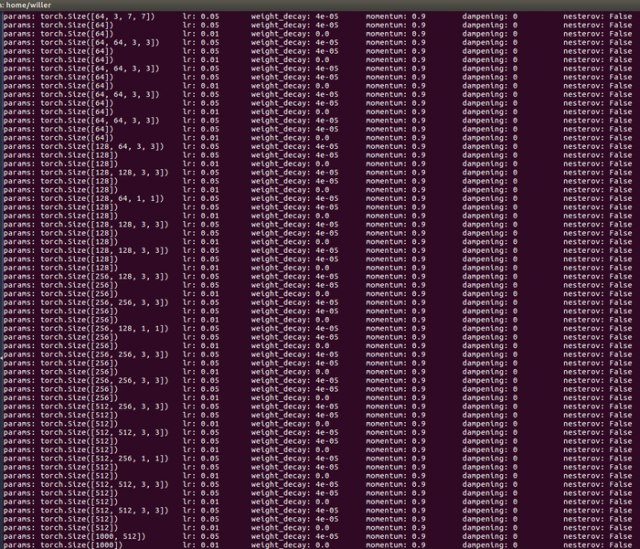

设置优化器参数,并打印

paras_new = []

for k, v in paras.items():

if 'bias' in k:

paras_new += [{'params': [v], 'lr': 0.02, 'weight_decay': 0}]

else:

paras_new += [{'params': [v], 'lr': 0.01, 'weight_decay': 0.00004}]

optimizer = torch.optim.SGD(paras_new, momentum=0.9)

for p in optimizer.param_groups:

outputs = ''

for k, v in p.items():

if k is 'params':

outputs += (k + ': ' + str(v[0].shape).ljust(30) + ' ')

else:

outputs += (k + ': ' + str(v).ljust(10) + ' ')

print(outputs)

结果为:

本文链接:http://task.lmcjl.com/news/12463.html